Luki w technologii rozpoznawania twarzy

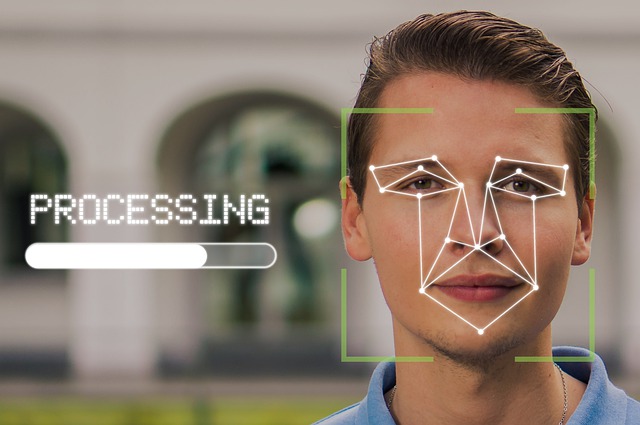

Technologia rozpoznawanie twarzy jest coraz częściej obecna w naszym życiu, wielu z nas używa jej kilka razy dziennie do odblokowania ekranu smartfona, podczas gdy duże firmy używają jej do identyfikacji konkretnych osób pośród dużego tłumu, analizy emocji i ich identyfikacji.

Pomimo postępu, jaki dokonał się w ostatnich latach, algorytmy uczenia maszynowego wciąż nie są dokładne i, jak wyjaśniono w artykule opublikowanym w hiszpańskiej wersji The Conversation, mogą dokonywać dyskryminacji ze względu na płeć i rasę lub mieć trudności z rozpoznawaniem transseksualistów.

Algorytmy uczenia maszynowego podążają za modelami oceny lub interpretacją zbudowaną dzięki przetwarzaniu dużych ilości danych, na przykład obrazów. Dlatego konieczne jest szkolenie maszyn z możliwie najbardziej reprezentatywnymi danymi dla każdego ludzkiego niuansu. Gdy tak się nie dzieje, a pewne kategorie osób są wykluczone, sztuczna inteligencja podaje niedokładne wyniki, odzwierciedlając popełnione przez nas niedokładności.

4 nowoczesne technologie na rynku funeralnym

Przykładem tego, jak niereprezentatywne gromadzenie danych rzeczywistości może negatywnie wpłynąć na funkcjonowanie produktu pochodzi bezpośrednio z ostatniego stulecia. W latach 1940-1990 Kodak i Polaroid używały tylko białych modeli do kalibracji swoich produktów, co pociągało za sobą problemy światła i kontrastu w renderowaniu wideo obiektów o ciemnej skórze.

Pomimo znamiennych przykładów Kodaka i Polaroida, wydaje się, że obecni giganci technologiczni niczego nie nauczyli się na błędach z przeszłości. Ostatnie badanie przeprowadzone przez Gender Shades ujawniło lukę w komercyjnym systemie klasyfikacji Microsoft, IBM i Face ++, stwierdzając, że kobiety z ciemniejszą skórą były podatne na więcej błędnych klasyfikacji niż reszta ludzi. Niezwykle popularna platforma komunikacyjna Zoom również wpadła w pułapkę dyskryminacji, kilku czarnych użytkowników skarżyło się, że aktywując wirtualne tło, ich twarz nie została rozpoznana i zniknęła z ekranu.

W badaniu przeanalizowano cztery komercyjne usługi rozpoznawania twarzy (Amazon Rekognition, Clarifai, IBM Watson Visual Recognition i Microsoft Azure) i obliczono dokładność wyników klasyfikacji płci dla 2450 obrazów. Jeśli dla mężczyzn i kobiet odsetek trafności zbliżał się do 100%, dla kobiet i mężczyzn transseksualistów spadł odpowiednio do 87% i 70%, a następnie spadł do 0% w przypadku osób aseksualnych.

Wniosek jest taki, że chociaż warto podkreślić najczęstsze błędy programistyczne, które dotykają systemy sztucznej inteligencji, a zwłaszcza spróbować poprawić ich dokładność i uniknąć dyskryminacji ze względu na płeć i rasę, ważne jest, aby zawsze mieć jasność co do trudności związanych z programowaniem maszyn do rozpoznawania różnorodności w porównaniu ze standardowym myśleniem jej projektantów.

Tekst powstał przy współpracy z: AppleHome – Serwis iPhone na Woli